L’uso dell’Intelligenza Artificiale (IA) nella guerra moderna è una realtà sempre più presente e preoccupante. Secondo un rapporto recente, l’uso dell’IA nella guerra aumenta del 30% ogni anno. Ma cosa significa esattamente questo aumento e come sta cambiando il volto della guerra? L’IA, come un assistente personale che aiuta a prendere decisioni rapide e precise, può essere utilizzata per analizzare grandi quantità di dati, come immagini satellitari o comunicazioni radio, per identificare pattern e prendere decisioni rapide.

Il contesto in cui si sta sviluppando l’uso dell’IA nella guerra è molto complesso e coinvolge diverse nazioni e organizzazioni. Le forze armate di tutto il mondo stanno investendo ingenti risorse nello sviluppo e nell’integrazione di sistemi informatici basati sull’IA. Questo aumento dell’uso dell’IA nella guerra ha portato a una serie di dibattiti e discussioni sulla sua efficacia e sulla sua etica. Alcuni sostengono che l’IA può aiutare a ridurre il numero di vittime civili e a migliorare l’efficacia delle operazioni militari, mentre altri sostengono che l’IA può aumentare il rischio di errori e di violazioni dei diritti umani.

L’esempio di Israele: il sistema ‘Lavender’

Uno degli esempi più documentati dell’uso dell’IA nella guerra è il sistema ‘Lavender’ utilizzato dalle forze israeliane. Secondo sei ufficiali dell’intelligence, il sistema ‘Lavender’ è stato utilizzato per classificare immagini e fondere dati da sensori diversi, suggerire priorità operative e aiutare i comandanti a prendere decisioni rapide e precise. L’IA, come un filtro che aiuta a selezionare le informazioni più importanti, può essere utilizzata per analizzare grandi quantità di dati e identificare pattern.

Il ruolo dell’IA nella deterrenza

Le forze armate di tutto il mondo investono ormai ingenti risorse nello sviluppo e nell’integrazione di sistemi informatici basati sull’IA. L’IA può essere utilizzata per migliorare l’efficacia delle operazioni militari e per ridurre il numero di vittime civili. Tuttavia, l’IA può anche aumentare il rischio di errori e di violazioni dei diritti umani. Quello che nessuno dice è che l’IA può anche essere utilizzata per migliorare la deterrenza, ovvero la capacità di dissuadere gli avversari dall’intraprendere azioni ostili.

I rischi legati all’uso dell’IA nella guerra

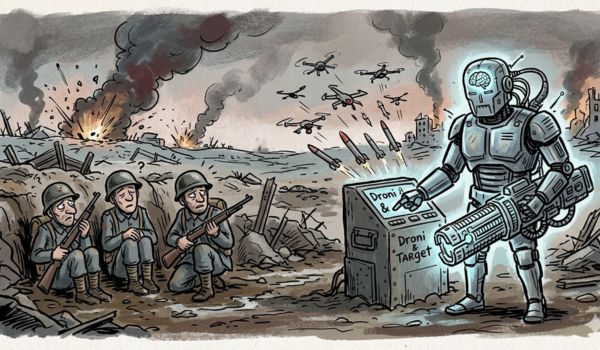

I rischi legati all’uso dell’IA nella guerra sono molti e vari. Uno dei principali rischi è l’aumento del numero di errori e di violazioni dei diritti umani. L’IA, come un computer che esegue istruzioni, può commettere errori se non è programmata correttamente. Inoltre, l’IA può anche aumentare il rischio di armi autonome, ovvero armi che possono prendere decisioni senza l’intervento umano.

- Il rischio di errori: l’IA può commettere errori se non è programmata correttamente, come un giudice che emette una sentenza sbagliata.

- Il rischio di armi autonome: l’IA può aumentare il rischio di armi autonome, ovvero armi che possono prendere decisioni senza l’intervento umano, come un drone che attacca senza essere stato programmato.

La necessità di regole ad hoc

La guerra in Iran ha riportato al centro del dibattito il ruolo dell’Intelligenza Artificiale nel contesto bellico. L’esercito americano sta investendo ingenti risorse nello sviluppo e nell’integrazione di sistemi informatici basati sull’IA. Tuttavia, l’uso dell’IA nella guerra è ancora poco regolamentato e ci sono poche norme che disciplinano il suo uso. Quello che nessuno dice è che c’è una necessità urgente di regole ad hoc per disciplinare l’uso dell’IA nella guerra, come un codice di condotta per gli sviluppatori di IA.

Il futuro della guerra: cosa cambia?

Il futuro della guerra è destinato a cambiare radicalmente con l’uso dell’IA. L’IA può essere utilizzata per migliorare l’efficacia delle operazioni militari e per ridurre il numero di vittime civili. Tuttavia, l’IA può anche aumentare il rischio di errori e di violazioni dei diritti umani. Quello che nessuno dice è che il futuro della guerra dipenderà anche dalla nostra capacità di creare regole ad hoc per disciplinare l’uso dell’IA, come un accordo internazionale per limitare l’uso di armi autonome.

L’angolo che manca agli altri articoli

Ma cosa succederà se non riusciremo a creare regole ad hoc per disciplinare l’uso dell’IA nella guerra? Il rischio è che l’IA possa essere utilizzata in modo irresponsabile e che possa portare a conseguenze disastrose. Quello che nessuno dice è che c’è una necessità urgente di dibattito e di discussione sull’uso dell’IA nella guerra, come un forum internazionale per discutere le implicazioni etiche dell’IA nella guerra.